Kali Linux [1] und Parrot Linux [2] gelten unter den Linux Distributionen, als die erste Wahl, wenn es um Security und Penetration Testing geht. Viele einschlägige Programme sind auf diesen Distributionen bereits vorinstalliert und können sozusagen out of the Box benutzt werden.

Allerdings muss man auch sagen, dass Kali und auch Parrot, wegen ihrer Spezialisierung nicht unbedingt die alltagstauglichsten Linux Distributionen sind. Für die tägliche Nutzung sind eher Ubuntu für Einsteiger und Debian für fortgeschrittene Anwender verbreitet. Aus diesem Grund werden Kali und Parrot meist als virtuelle Maschinen mit VirtualBox oder dem VMWare Player aufgesetzt und genutzt. Ein durchaus praktikabler Ansatz, vor allem wenn es darum geht, sich erst einmal die Distribution anzuschauen, bevor man sie auf den Rechner nativ installiert.

Aus meiner Sicht ist das sogenannte Distributions-Hopping, das manche Leute unter Linux betreiben, eher hinderlich, sich an ein System zu gewöhnen, um damit effizient arbeiten zu können. Auf welches Linux die Wahl fällt, hängt vor allem vom eigenen Geschmack ab und von den Anforderungen, was man damit machen möchte. Entwickler und Systemadministratoren, werden wahrscheinlich eine Neigung zu Debian haben, einer Version, von der viele andere Distributionen abgeleitet wurden. Windowsumsteiger erfreuen sich oft an Linux Mint, und so lässt sich die Liste weiter fortsetzen.

Wer sich als Hacker fühlen möchte, entscheidet sich gern für eine Kali-Installation. Oft sind dabei Dinge wie Privatsphäre und anonymes Surfen im Internet die eigentlichen Bewegründe. Hierzu hatte ich bereits Kodachi Linux, das auf anonymes Surfen im Internet spezialisiert ist, vorgestellt. Natürlich muss man ganz klar sagen, dass es im Internet keine wirkliche anonyme Kommunikation gibt. Man kann aber die Anzahl möglicher Lauscher mit einigen leicht umzusetzenden Maßnahmen massiv reduzieren. Das Thema Privatsphäre habe ich auf diesem Blog in mehreren Artikeln zur Ansprache gebracht. Auch wenn es für viele eine unpopuläre Meinung ist. Aber eine Linux VM die über ein Apple- oder Windows-Betriebssystem zum anonymen Surfen hergenommen wird, verfehlt ihren Nutzen vollständig.

Der erste Punkt in der Rubrik „Privatsphäre“ ist der Internetbrowser. Ganz gleich, welchen man verwendet und wie sehr die verschiedenen Hersteller den Schutz der Privatsphäre hervorheben, in der Realität ist es wie in dem Märchen „Des Kaisers neue Kleider“. Den meisten Nutzern ist das Tor / Onion Netzwerk namentlich bekannt. Dahinter steckt der Torbrowser, den man einfach über die Webseite des Tor Projektes [3] herunterladen kann. Nach dem Download und dem Entpacken des Verzeichnisses lässt sich der Tor Browser über das Startscript auf der Konsole öffnen.

./Browser/start-tor-browser

Wer im Tor-Netzwerk unterwegs ist, kann URLs mit der Endung .onion besuchen. Ein großer Teil dieser Seiten ist als das sogenannte Darknet bekannt und sollte mit großer Vorsicht angesurft werden. Zu einem kann man hier auf sehr verstörende und auch illegale Inhalte stoßen, aber auch Opfer von Phishing Attacken und Ähnlichem werden. Ohne zu sehr auf die Details einzugehen, wie das Tor-Netzwerk genau funktioniert, sollte man sich durchaus im Klaren sein, dass man auch hier nicht völlig anonym unterwegs ist. Auch wenn man sich den großen Big-Tech-Firmen weitgehend entzieht, haben Behörden, vor allem wenn es um illegale Aktionen geht, durchaus Mittel und Möglichkeiten. Dazu gibt es in der einschlägigen Presse genügend Beispiele.

Wenn man nun darüber nachdenkt, wie das Internet in groben Zügen funktioniert, findet man auch schon den nächsten wichtigen Punkt: Proxy Server. Proxy Server sind sogenannte Stellvertreter, die ähnlich wie im Tor-Netzwerk die Anfragen ins Internet nicht an die Homepage direkt senden, sondern über einen fremden Server, der diese Anfrage weiterleitet und dann die Antwort zurückliefert. Ruft man zum Beispiel über einen Proxy die Internetseite von Google auf, so erscheint bei Google lediglich die IP-Adresse des Proxy Servers. Auch der eigene Provider sieht nur, dass man eine Anfrage zu einem bestimmten Server geschickt hat. Dass dieser Server dann eine Anfrage an Google stellt, sieht der Provider in den eigenen Logfiles nicht. Auf beiden Seiten, beim Provider und auf der Ziel Internetseite erscheint nur der Proxy Server. In der Regel versichern die Betreibe von Proxy Servern, dass sie selbst keine Logs mit der Original-IP ihrer Klienten speichern. Leider gibt es für diese Aussagen keine Garantie. Um hier die Wahrscheinlichkeit, erkannt zu werden, weiter zu reduzieren, kann man mehrere Proxy-Verbindungen hintereinanderschalten. Mit dem Konsolenprogramm proxychain, lässt sich dieses Vorhaben leicht umsetzen. ProxyChain ist unter Debian Distributionen schnell mit dem Paketmanager APT installiert.

sudo apt-get install proxychains4

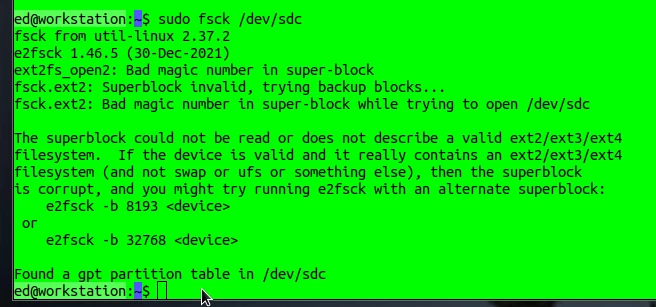

Die Verwendung ist ebenso einfach. Über die Konfigurationsdatei /etc/proxychain.conf wird das Verhalten für proxychain festgelegt. Wenn man den Arbeitsmodus von stricht_chain auf random_chain ändert, wird bei jeder Verbindung eine andere Variation der einzelnen Proxy-Server zufällig zusammengestellt. Am Ende der Konfigurationsdatei kann man die einzelnen Proxy-Server eintragen. Dazu sind einige Beispiele in der Datei enthalten. Um proxychain zu verwenden, ruft man es einfach über die Konsole auf, gefolgt von der Anwendung (dem Browser), welche über die Proxys die Verbindung ins Internet aufbaut.

Proxychanin firefox

## RFC6890 Loopback address range

## if you enable this, you have to make sure remote_dns_subnet is not 127

## you'll need to enable it if you want to use an application that

## connects to localhost.

# localnet 127.0.0.0/255.0.0.0

# localnet ::1/128Die wirkliche Herausforderung ist das Finden geeigneter Proxy-Server. Für den Anfang findet man unter [4] eine große Auswahl weltweit freier Proxys.

Das alleinige Verwenden von Proxys für Verbindungen ins Internet biete nur bedingte Anonymität. Damit sich zwei Computer unterhalten, wird zwar eine IP Adresse benötigt, die über den Provider des Internetzugangs zur richtigen geografischen Adresse, wo der Computer steht, verknüpft werden kann. Über die Netzwerkkarte wird allerdings noch eine weitere Information ins Netz gesendet. Die sogenannte MAC Adresse, mit der man einen Computer direkt identifizieren kann. Da man nicht bei jedem Neustart des Computers eine neue Netzwerkkarte einbauen muss, um eine andere MAC-Adresse zu bekommen, kann man ein kleines, einfaches Tool namens macchanger nutzen. Dies ist wie proxychain ebenfalls problemlos über APT zu installieren. Nach der Installation kann man den Autostart festlegen und man muss sich entscheiden, ob immer dieselbe MAC Adresse oder jedes Mal eine zufällig neu generierte MAC Adresse verwendet werden soll.

Die bisher vorgestellten Maßnahmen nützen natürlich nur dann etwas, wenn die Verbindung ins Internet auch verschlüsselt ist. Das geschieht über die sogenannten Secure Socket Layer (SSL). Wenn man sich nicht über einen VPN mit dem Internet verbindet und die aufgerufenen Webseiten anstatt von https nur http verwenden, kann man mit einem beliebigen Paketsniffer (z. B. dem Programm Wireshark) die Kommunikation mitschneiden und den Inhalt der Kommunikation im Klartext lesen. Auf diese Weise werden in öffentlichen Netzwerken (WiFi) Passwörter oder vertrauliche Nachrichten ausgespäht. Wir können sehr sicher davon ausgehen, dass Internetprovider sämtliche Kommunikation ihrer Kunden über sogenannte Paketfilter laufen lassen, um verdächtige Aktionen zu erkennen. Bei https Verbindungen können diese Filter nicht in die Pakete hineinschauen.

Nun könnte man auf die Idee kommen, mit all den bisher beschriebenen Maßnahmen sich illegal in ein fremdes Netzwerk zu verbinden. Schließlich weiß dann keiner, dass man da ist, und alle Aktivitäten im Internet werden dem Anschlussinhaber zugeordnet. Aus diesem Grund möchte ich ausdrücklich darauf hinweisen, dass in so ziemlich allen Ländern solche Aktionen strafbar sind und man, wenn man dabei erwischt wird, schnell im Gefängnis landen kann. Wer mehr über das Thema WiFi Sicherheit erfahren möchte, um das eigene Netzwerk vor illegalem Zugriff zu schützen, findet im Mitgliederbereich (Subscription) einen ausführlichen Workshop zu Aircrack-ng.

Der nächste Punkt auf der Liste zum Thema Privatsphäre ist E-Mail. Für die meisten Menschen ist es einfach nicht möglich, dass sie ihren eigenen E-Mail Server betreiben. Der Aufwand ist enorm und auch nicht ganz kostengünstig. Deswegen werden Angebote von Google, Microsoft und Co. einen E-Mail-Dienst bereitzustellen, gern angenommen. Wer diesen Dienst nicht über einen lokalen Client nutzt und die verschickten E-Mails nicht kryptografisch verschlüsselt, kann sich sicher sein, dass die Mail Anbieter die Mails scannen und mitlesen. Außnahmslos! Da die Konfiguration eines Mail Clients mit funktionierender Verschlüsselung eher ein Geek Thema ist, genauso wie das Betreiben eines eigenen Mailservers, sind hier die Optionen sehr eingeschränkt. Einzige Lösung ist der Schweizer Anbieter Proton [5], der auch kostenfreie Mail-Accounts bereitstellt. Proton wirbt mit dem Schutz der Privatsphäre ihrer Kunden und setzt diesen durch strikte Verschlüsselung um. Ob man dennoch vertrauliche Nachrichten per E-Mail verschicken sollte, muss jeder für sich selbst klären. Das gilt natürlich auch für die verfügbaren Messenger, die mittlerweile sehr viel für Telefonie genutzt werden.

Viele Menschen haben sich einmal selbst gegoogelt, um zu erfahren, welche digitalen Spuren sie im Internet bisher hinterlassen haben. Dies kratzt natürlich nur an der Oberfläche, denn die Leute im Personalwesen von größeren Firmen und Konzernen nutzen effektivere Wege. Ein sehr professionelles Werkzeug ist Matego, aber auch im Open Source Bereich findet sich ein mächtiges Tool, das so einige Sachen zutage fördern kann. Auch hierzu gibt es für Subscriber einen entsprechenden Workshop. Denn wenn man seine Spuren findet, kann man sich auch daran machen, sie zu verwischen.

Wie man sehen kann, ist das Thema Privatsphäre und Anonymität sehr umfangreich und mit diesem kleinen Artikel auch nur oberflächlich behandelt. Dennoch ist die Informationstiefe ausreichend, um einen ersten Eindruck des Sachverhalts zu bekommen. Es reicht bei weitem nicht aus, sich ein System wie Kali aufzusetzen, wenn man die Grundlagen nicht kennt, um die Werkzeuge auch korrekt einzusetzen. Denn wenn man die verschiedenen Puzzelteile nicht akkurat zusammensetzt, bleibt die erhoffte Wirkung, sich durch Anonymität mehr Privatsphäre im Internet zu verschaffen. Dieser Artikel erklärt auch auf technischer Ebene meinen persönlichen Standpunkt, wieso es keine sichere, anonyme elektronische Kommunikation gibt. Wer sich in das Thema einarbeiten möchte, erzielt mit einer sinnvollen Strategie und dem stückweise erweiterten eigenen System schneller Erfolge, als mit einem bereits vorgefertigten Allround Werkzeug wie Kali Linux.